AI对抗样本,作为人工智能领域的一个新兴研究方向,不仅展现了技术上的创新潜力,也揭示了人工智能系统在面对精心设计的输入时可能存在的脆弱性。这种脆弱性不仅影响了AI系统的准确性,还引发了关于技术伦理和安全性的广泛讨论。本文将从技术原理、应用场景、伦理问题以及应对策略等多个方面,全面解析AI对抗样本这一现象。

AI对抗样本是指通过人为设计或生成的方式,使得原本能够正确识别的图像、语音或其他形式的数据,在经过处理后,导致AI模型产生错误判断的一类数据。例如,在图像分类任务中,一张原本被准确识别为“猫”的照片,经过微小的扰动后,AI模型可能会将其误判为“狗”。这类现象最初是在机器学习领域提出的概念,随着深度学习技术的发展,AI对抗样本的研究逐渐成为学术界和工业界关注的重点。

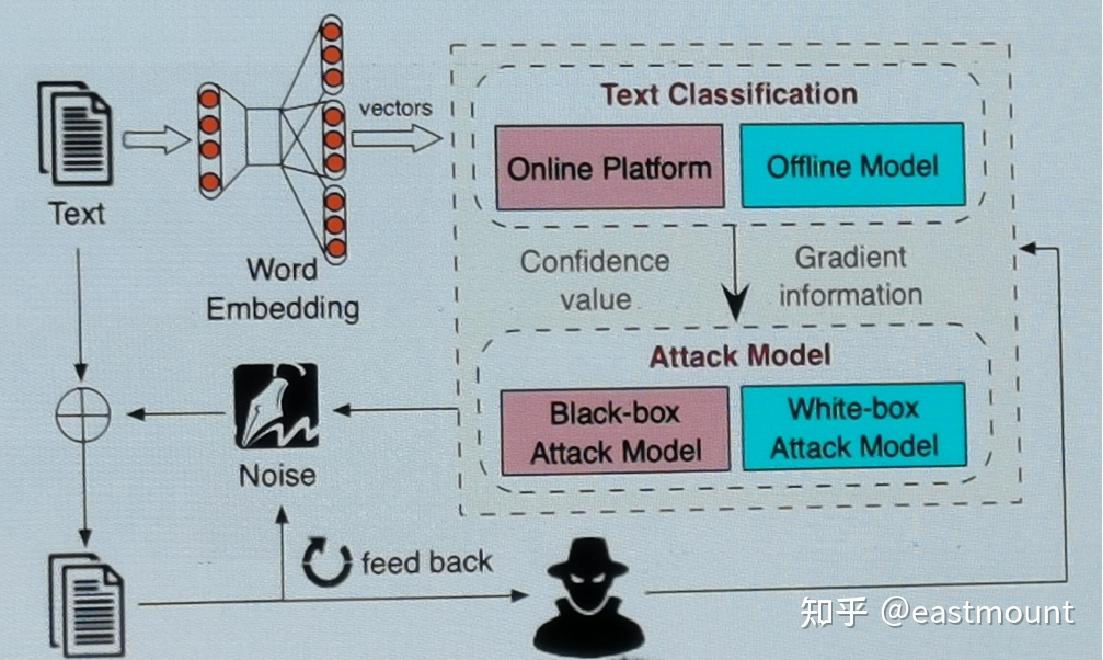

AI对抗样本的生成通常基于优化算法,这些算法旨在最小化目标函数的同时最大化预测误差。具体而言,研究人员会利用梯度下降等优化方法,调整输入数据中的某些像素值或特征向量,使其在不显著改变人类感知的情况下,导致AI模型输出错误的结果。还有一些基于随机搜索的方法,通过大量的尝试来寻找有效的扰动。

AI对抗样本不仅仅存在于实验室环境中,它们已经在多个实际应用场景中被发现并验证。例如,在自动驾驶汽车领域,AI对抗样本可能导致车辆错误地识别道路标志,从而引发交通事故;在网络安全领域,攻击者可以利用AI对抗样本绕过防火墙或入侵检测系统;在医疗影像诊断中,AI对抗样本可能会导致医生误诊,给患者带来不必要的风险。这些实例充分说明了AI对抗样本对于社会公共安全的重要性。

AI对抗样本的存在挑战了人们对AI系统的信任。当人们依赖于AI技术进行决策时,如果发现AI系统存在容易受到攻击的情况,那么他们可能会对AI技术失去信心,进而影响整个行业的健康发展。AI对抗样本也可能侵犯个人隐私。例如,在人脸识别系统中,攻击者可以通过生成特定的AI对抗样本,欺骗摄像头识别出错误的身份信息,从而达到窃取他人身份的目的。AI对抗样本还可能加剧数字鸿沟,使得弱势群体更容易受到技术滥用的影响。

除了上述提到的伦理挑战外,AI对抗样本还带来了许多安全方面的威胁。一方面,攻击者可以利用AI对抗样本对现有的AI系统发起攻击,破坏系统的正常运行;另一方面,防御者需要不断改进自己的防护措施,以防止AI对抗样本带来的威胁。由于AI对抗样本的多样性,防御工作往往非常困难且耗时较长。因此,如何有效应对AI对抗样本成为了一个亟待解决的问题。

为了应对AI对抗样本带来的各种挑战,我们需要采取多方面的措施。首先是加强法律法规建设,明确AI对抗样本的相关法律责任,为打击此类行为提供法律依据。其次是推动技术创新,开发更加 robust 的AI算法,提高系统的抗干扰能力。最后是加强公众教育,提高社会各界对AI对抗样本的认识和防范意识。

AI对抗样本是一个复杂而多维的现象,它既反映了人工智能技术的进步,也暴露了其中存在的潜在风险。我们应该正视这些问题,并积极寻求解决方案,以确保AI技术的安全可靠发展,造福全人类。

标签: 技术背后的伦理与安全挑战、 解析AI对抗样本、本文地址: https://www.2drx.com/hlwzxwz/441d91eedad504b1a853.html

上一篇:揭开AI红队测试的神秘面纱挑战与机遇并存的...